Máxima Verossimilhança Estimativa de > Algoritmo EM (Expectation-maximization)

Você pode querer ler este artigo primeiro: Qual é a Estimativa de Máxima Verossimilhança?

Qual é o algoritmo EM?

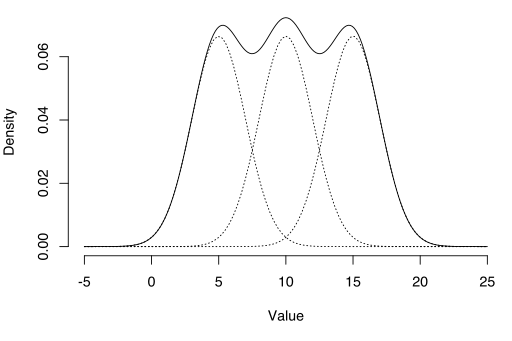

EM algoritmo pode ser utilizado para estimativa de variáveis latentes, como os que vêm da mistura de distribuições (você sabe que eles vieram de uma mistura, mas não específico de distribuição).

o algoritmo de maximização de expectativa (EM) é uma maneira de encontrar estimativas de máxima probabilidade para parâmetros de modelo quando seus dados estão incompletos, tem pontos de dados em falta, ou tem variáveis latentes não observáveis (ocultas). É uma forma iterativa de aproximar a função de máxima probabilidade. Enquanto a estimativa máxima da probabilidade pode encontrar o modelo “melhor ajuste” para um conjunto de dados, ele não funciona particularmente bem para conjuntos de dados incompletos. O algoritmo EM mais complexo pode encontrar Parâmetros de modelo, mesmo que você tenha dados em falta. Ele funciona escolhendo valores aleatórios para os pontos de dados em falta, e usando essas suposições para estimar um segundo conjunto de dados. Os novos valores são usados para criar um melhor palpite para o primeiro conjunto, e o processo continua até que o algoritmo converge em um ponto fixo.

See also: EM Algorithm explained in one picture.

MLE vs. em

embora a estimativa da probabilidade máxima (MLE) e EM possam ambos encontrar os parâmetros “mais adequados”, como eles acham que os modelos são muito diferentes. MLE acumula todos os dados primeiro e então usa esses dados para construir o modelo mais provável. A EM tenta adivinhar primeiro os parâmetros-contabilizando os dados em falta-ajustando depois o modelo para se ajustar às hipóteses e aos dados observados. Os passos básicos para o algoritmo São::

- um palpite inicial é feito para os parâmetros do modelo e uma distribuição de probabilidade é criada. Isto às vezes é chamado de “E-Step” para a distribuição “esperada”.

- os dados recentemente observados são introduzidos no modelo.

- a distribuição de probabilidade do E-step é ajustada para incluir os novos dados. Isto às vezes é chamado de “M-step”.”

- os passos 2 a 4 são repetidos até que a estabilidade (ou seja, uma distribuição que não muda do passo-E para o passo-M) seja alcançada.

o algoritmo EM melhora sempre a estimativa de um parâmetro através deste processo multi-etapas. No entanto, às vezes, ele precisa de alguns aleatórios começa a encontrar o melhor modelo, porque o algoritmo pode contar com um máximo local que não é tão próximo do (ideal) máximo global. Em outras palavras, ele pode funcionar melhor se você forçá-lo a reiniciar e tomar esse “palpite inicial” do Passo 1 novamente. A partir de todos os parâmetros possíveis, você pode então escolher o que tem a maior probabilidade máxima.

na realidade, os passos envolvem algum cálculo bastante pesado (integração) e probabilidades condicionais, que está além do escopo deste artigo. Se você precisa de uma discriminação mais técnica (ou seja, baseada em cálculo) do processo, eu recomendo que você leia Gupta e Chen de 2010 artigo.

Applications

The EM algorithm has many applications, including:

- dis-entangling superimposed signals,

- Estimating Gaussian mixture models (GMMs),

- Estimating hidden Markov models (HMMs),

- Estimating parameters for compound Dirichlet distributions,

- Finding optimal mixtures of fixed models.

Limitations

the EM algorithm can be very slow, even on the fastest computer. Funciona melhor quando você só tem uma pequena porcentagem de dados em falta e a dimensionalidade dos dados não é muito grande. Quanto maior a dimensionalidade, mais lento o e-step; para dados com dimensionalidade maior, você pode achar que o e-step corre extremamente lento à medida que o procedimento se aproxima de um máximo local.

Dempster, A., Laird, N., and Rubin, D. (1977) Maximum probability from incomplete data via the EM algorithm, Journal of the Royal Statistical Society. Series B (Methodological), vol. 39, No. 1, pp. 1ñ38.

Gupta, M. & Chen, Y. (2010) Theory and Use of the EM Algorithm. Foundations and Trends in Signal Processing, Vol. 4, No. 3 223-296.

Stephanie Glen. “Em Algorithm (Expectation-maximization): Definição simples ” de StatisticsHowTo.com: Elementary Statistics for the rest of us! https://www.statisticshowto.com/em-algorithm-expectation-maximization/

——————————————————————————

Precisa de ajuda com a lição de casa ou a pergunta de teste? Com o estudo Chegg, você pode obter soluções passo a passo para suas perguntas de um especialista no campo. Os seus primeiros 30 minutos com um tutor Chegg são grátis!