estimarea probabilității maxime > algoritmul EM (așteptare-maximizare)

s-ar putea să doriți să citiți mai întâi acest articol: Ce este estimarea probabilității maxime?

ce este algoritmul EM?

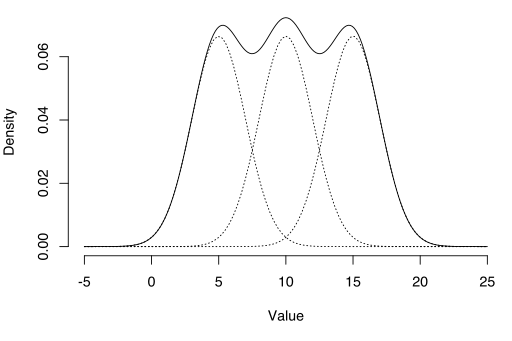

algoritmul EM poate fi folosit pentru a estima variabile latente, cum ar fi cele care provin din distribuții de amestec (știți că provin dintr-un amestec, dar nu care distribuție specifică).

algoritmul de maximizare a așteptărilor (EM) este o modalitate de a găsi estimări de probabilitate maximă pentru parametrii modelului atunci când datele dvs. sunt incomplete, au puncte de date lipsă sau au variabile latente neobservate (ascunse). Este un mod iterativ de aproximare a funcției de probabilitate maximă. În timp ce estimarea maximă a probabilității poate găsi modelul „cel mai potrivit” pentru un set de date, acesta nu funcționează deosebit de bine pentru seturile de date incomplete. Algoritmul EM mai complex poate găsi parametrii modelului chiar dacă aveți date lipsă. Funcționează alegând valori aleatorii pentru punctele de date lipsă și folosind aceste presupuneri pentru a estima un al doilea set de date. Noile valori sunt utilizate pentru a crea o presupunere mai bună pentru primul set, iar procesul continuă până când algoritmul converge pe un punct fix.

Vezi și: algoritmul EM explicat într-o singură imagine.

MLE vs.EM

deși estimarea probabilității maxime (MLE) și EM pot găsi ambii parametri „cei mai potriviți”, modul în care găsesc modelele sunt foarte diferite. MLE acumulează mai întâi toate datele și apoi le folosește pentru a construi modelul cel mai probabil. EM ghicește mai întâi parametrii—contabilizând datele lipsă—apoi ajustează modelul pentru a se potrivi cu presupunerile și datele observate. Pașii de bază pentru algoritm sunt:

- se face o presupunere inițială pentru parametrii modelului și se creează o distribuție de probabilitate. Aceasta este uneori numită” pasul E „pentru distribuția” așteptată”.

- datele recent observate sunt introduse în model.

- distribuția probabilității din pasul E este modificată pentru a include noile date. Aceasta este uneori numită „pasul M”.”

- pașii de la 2 la 4 Se repetă până când se atinge stabilitatea (adică o distribuție care nu se schimbă de la Pasul E la Pasul M).

algoritmul EM îmbunătățește întotdeauna estimarea unui parametru prin acest proces în mai multe etape. Cu toate acestea, uneori are nevoie de câteva porniri aleatorii pentru a găsi cel mai bun model, deoarece algoritmul poate perfecționa o maximă locală care nu este atât de apropiată de maximele globale (optime). Cu alte cuvinte, poate funcționa mai bine dacă îl forțați să repornească și să luați din nou acea „presupunere inițială” de la Pasul 1. Dintre toți parametrii posibili, îl puteți alege pe cel cu cea mai mare probabilitate maximă.

în realitate, pașii implică unele calcule destul de grele (integrare) și probabilități condiționale, care depășesc domeniul de aplicare al acestui articol. Dacă aveți nevoie de o defalcare mai tehnică (adică bazată pe calcul) a procesului, vă recomand să citiți lucrarea din 2010 a lui Gupta și Chen.

Aplicații

algoritmul EM are multe aplicații, inclusiv:

- Dis-entangling semnale suprapuse,

- estimarea modelelor de amestec Gaussian (GMM),

- estimarea modelelor Markov ascunse (Hmm),

- estimarea parametrilor pentru distribuțiile Dirichlet compuse,

- găsirea amestecurilor optime de modele fixe.

limitări

algoritmul EM poate fi foarte lent, chiar și pe cel mai rapid computer. Funcționează cel mai bine atunci când aveți doar un procent mic de date lipsă și dimensionalitatea datelor nu este prea mare. Cu cât este mai mare dimensionalitatea, cu atât pasul E este mai lent; pentru datele cu dimensionalitate mai mare, puteți găsi că e-step rulează extrem de lent pe măsură ce procedura se apropie de un maxim local.

Dempster, A., Laird, N. și Rubin, D. (1977) probabilitate maximă din date incomplete prin algoritmul EM, Jurnalul Societății Regale de Statistică. Seria B (metodologică), vol. 39, nr. 1, pp.1 int. 38.

Gupta, M. & Chen, Y. (2010) Teoria și utilizarea algoritmului EM. Fundații și tendințe în procesarea semnalelor, Vol. 4, nr. 3 223-296.

Stephanie Glen. „Algoritmul EM (așteptare-maximizare): Definiție simplă ” din StatisticsHowTo.com: statistici elementare pentru restul dintre noi! https://www.statisticshowto.com/em-algorithm-expectation-maximization/

——————————————————————————

aveți nevoie de ajutor cu o temă sau o întrebare de testare? Cu studiul Chegg, puteți obține soluții pas cu pas la întrebările dvs. de la un expert în domeniu. Primele 30 de minute cu un tutore Chegg sunt gratuite!