maksimal Sandsynlighedsestimering > EM-algoritme (Forventningsmaksimering)

du vil måske læse denne artikel først: hvad er maksimal Sandsynlighedsestimering?

Hvad er EM-algoritmen?

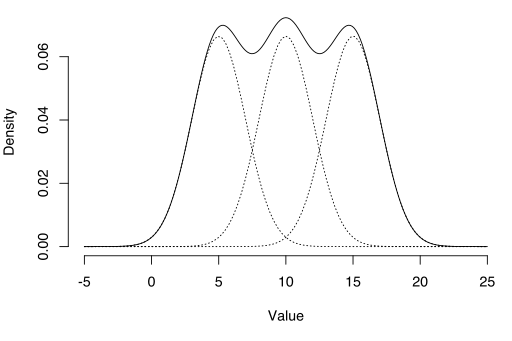

EM-algoritmen kan bruges til at estimere latente variabler, som dem, der kommer fra blandingsfordelinger (du ved, at de kom fra en blanding, men ikke hvilken specifik distribution).

em-algoritmen (forventning-maksimering) er en måde at finde estimater for maksimal sandsynlighed for modelparametre, når dine data er ufuldstændige, mangler datapunkter eller har ikke-observerede (skjulte) latente variabler. Det er en iterativ måde at tilnærme den maksimale sandsynlighedsfunktion på. Mens estimering af maksimal sandsynlighed kan finde den” bedste pasform ” – model for et sæt data, fungerer det ikke særlig godt for ufuldstændige datasæt. Den mere komplekse EM-algoritme kan finde modelparametre, selvom du mangler data. Det fungerer ved at vælge tilfældige værdier for de manglende datapunkter og bruge disse gæt til at estimere et andet sæt data. De nye værdier bruges til at skabe et bedre gæt for det første sæt, og processen fortsætter, indtil algoritmen konvergerer på et fast punkt.

Se også: EM algoritme forklaret i et billede.

MLE vs. EM

selvom maksimal Sandsynlighedsestimering (MLE) og EM begge kan finde “best-fit” parametre, hvordan de finder modellerne er meget forskellige. MLE akkumulerer alle dataene først og bruger derefter disse data til at konstruere den mest sandsynlige model. EM gætter først på parametrene-tegner sig for de manglende data—tilpasser derefter modellen, så den passer til gætterne og de observerede data. De grundlæggende trin for algoritmen er:

- et indledende gæt er lavet for modelens parametre, og der oprettes en sandsynlighedsfordeling. Dette kaldes undertiden “E-trin” for den “forventede” distribution.

- nyligt observerede data føres ind i modellen.

- sandsynlighedsfordelingen Fra e-trinnet justeres for at inkludere de nye data. Dette kaldes undertiden ” M-trin.”

- Trin 2 til 4 gentages, indtil stabilitet (dvs.en fordeling, der ikke ændres fra E-trin til M-trin) er nået.

EM-algoritmen forbedrer altid en parameters estimering gennem denne flertrinsproces. Imidlertid har det nogle gange brug for et par tilfældige begynder at finde den bedste model, fordi algoritmen kan finpudse på et lokalt Maksima, der ikke er så tæt på det (optimale) globale Maksima. Med andre ord kan det fungere bedre, hvis du tvinger det til at genstarte og tage det “indledende gæt” fra Trin 1 igen. Fra alle de mulige parametre kan du derefter vælge den med den største maksimale sandsynlighed.

i virkeligheden involverer trinene nogle temmelig tunge beregninger (integration) og betingede sandsynligheder, som ligger uden for denne artikels anvendelsesområde. Hvis du har brug for en mere teknisk (dvs.beregningsbaseret) opdeling af processen, anbefaler jeg stærkt, at du læser Gupta og Chens 2010-papir.

applikationer

EM-algoritmen har mange applikationer, herunder:

- dis-entangling overlejrede signaler,

- estimering af gaussiske blandingsmodeller (GMM ‘er),

- estimering af skjulte Markov-modeller (Hmm’ er),

- estimering af parametre for sammensatte Dirichlet-distributioner,

- find optimale blandinger af faste modeller.

begrænsninger

EM-algoritmen kan være meget langsom, selv på den hurtigste computer. Det fungerer bedst, når du kun har en lille procentdel af manglende data, og dataens dimensionalitet ikke er for stor. Jo højere dimensionalitet, jo langsommere E-trin; for data med større dimensionalitet kan du finde E-step kører ekstremt langsomt, da proceduren nærmer sig et lokalt maksimum.

Dempster, A., Laird, N. og Rubin, D. (1977) maksimal sandsynlighed fra ufuldstændige data via EM-algoritmen, Journal of the Royal Statistical Society. Serie B (metodologisk), vol. 39, nr. 1, s. 1 Til 38.

Gupta, M. & Chen, Y. (2010) teori og brug af EM-algoritmen. Fundamenter og tendenser i signalbehandling, Vol. 4, Nr. 3 223-296.

Stephanie Glen. “EM-algoritme (forventning-maksimering): Enkel Definition ” fra StatisticsHowTo.com: elementær statistik for resten af os! https://www.statisticshowto.com/em-algorithm-expectation-maximization/

——————————————————————————

brug for hjælp til et hjemmearbejde eller test spørgsmål? Med Chegg Study kan du få trinvise løsninger på dine spørgsmål fra en ekspert på området. Dine første 30 minutter med en Chegg tutor er gratis!