maximális valószínűség becslés > EM algoritmus (elvárás-Maximalizálás)

először érdemes elolvasni ezt a cikket: Mi a maximális valószínűség becslés?

mi az EM algoritmus?

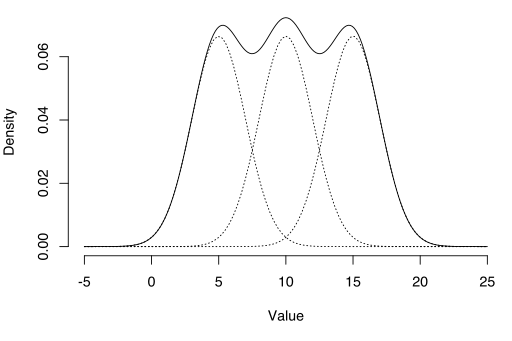

az EM algoritmus használható a látens változók becslésére, mint például azok, amelyek keverékeloszlásokból származnak (tudod, hogy keverékből származnak, de nem melyik specifikus Eloszlás).

az elvárás-Maximalizálás (em) algoritmus a modellparaméterek maximális valószínűségi becsléseinek megkeresésére szolgál, ha az adatok hiányosak, hiányzó adatpontokkal rendelkeznek, vagy nem megfigyelt (rejtett) látens változókkal rendelkeznek. Ez egy iteratív módszer a maximális valószínűség függvény közelítésére. Míg a maximális valószínűség becslése megtalálja a” legjobban illeszkedő ” modellt egy adatkészlethez, a hiányos adatkészletek esetében nem működik különösen jól. A bonyolultabb EM algoritmus akkor is megtalálja a modell paramétereit, ha hiányzik az adat. Úgy működik, hogy véletlenszerű értékeket választ a hiányzó adatpontokhoz, és ezeket a találgatásokat használja a második adatkészlet becsléséhez. Az új értékeket az első halmaz jobb kitalálására használják, és a folyamat addig folytatódik, amíg az algoritmus egy fix pontra konvergál.

Lásd még: EM algoritmus magyarázata egy képen.

MLE vs.EM

bár a maximális valószínűség becslés (mle) és az EM egyaránt megtalálja a “legjobban illeszkedő” paramétereket, a modellek megtalálása nagyon eltérő. Az MLE először összegyűjti az összes adatot, majd ezeket az adatokat felhasználja a legvalószínűbb modell felépítéséhez. EM először kitalálja a paramétereket—figyelembe véve a hiányzó adatokat -, majd módosítja a modellt, hogy illeszkedjen a találgatásokhoz és a megfigyelt adatokhoz. Az algoritmus alapvető lépései a következők:

- egy kezdeti találgatás készül a modell paramétereit, és egy valószínűségi eloszlás jön létre. Ezt néha “e-lépésnek” nevezik a “várható” eloszláshoz.

- újonnan megfigyelt adatok kerülnek a modellbe.

- a valószínűségi eloszlás az E-lépés csípett, hogy tartalmazza az új adatokat. Ezt néha “M-lépésnek” nevezik.”

- a 2-4. lépéseket addig ismételjük, amíg el nem érjük a stabilitást (azaz olyan eloszlást, amely nem változik az E-lépéstől az M-lépésig).

az EM algoritmus mindig javítja a paraméter becslését ezen a többlépcsős folyamaton keresztül. Néha azonban néhány véletlenszerű indításra van szükség a legjobb modell megtalálásához, mert az algoritmus olyan helyi maximákat tud csiszolni, amelyek nem állnak olyan közel az (optimális) globális maximumhoz. Más szavakkal, jobban teljesíthet, ha újraindításra kényszeríti, és újra megteszi ezt a “kezdeti találgatást” az 1.lépéstől. Az összes lehetséges paraméter közül kiválaszthatja azt, amelyik a legnagyobb valószínűséggel rendelkezik.

a valóságban a lépések meglehetősen nehéz kalkulust (integrációt) és feltételes valószínűségeket tartalmaznak, ami túlmutat a cikk hatályán. Ha szüksége van egy technikai (azaz kalkulus alapú) bontását a folyamat, azt ajánlom, hogy olvassa el Gupta és Chen 2010 papír.

Alkalmazások

az EM algoritmusnak számos alkalmazása van, beleértve:

- dis-összefonódó egymásra helyezett jelek,

- Gauss keverékmodellek (GMM) becslése,

- rejtett Markov modellek becslése (HMMs),

- a Dirichlet-Eloszlás összetett paramétereinek becslése,

- rögzített modellek optimális keverékeinek megtalálása.

korlátozások

az EM algoritmus nagyon lassú lehet, még a leggyorsabb számítógépen is. Ez akkor működik a legjobban, ha a hiányzó adatoknak csak kis százaléka van, és az adatok mérete nem túl nagy. Minél nagyobb a dimenzió, annál lassabb az E-lépés; nagyobb méretű adatok esetén előfordulhat, hogy az E-lépés rendkívül lassan fut, mivel az eljárás megközelíti a helyi maximumot.

Dempster, A., Laird, N., and Rubin, D. (1977) maximális valószínűség hiányos adatokból keresztül az EM algoritmus, Journal of the Royal Statistical Society. B sorozat (Módszertani), vol. 39, 1. szám, 1.O. 68.

Gupta, M. & Chen, Y. (2010) az EM algoritmus elmélete és használata. A jelfeldolgozás alapjai és trendjei, Vol. 4, 3. szám 223-296.

Stephanie Glen. “EM algoritmus (elvárás-Maximalizálás): Egyszerű meghatározás ” tól től StatisticsHowTo.com: elemi statisztika a többiek számára! https://www.statisticshowto.com/em-algorithm-expectation-maximization/

——————————————————————————

segítségre van szüksége a házi feladat vagy teszt kérdés? A Chegg Study segítségével lépésről lépésre megoldásokat kaphat kérdéseire a terület szakértőjétől. Az első 30 perc egy Chegg oktatóval ingyenes!